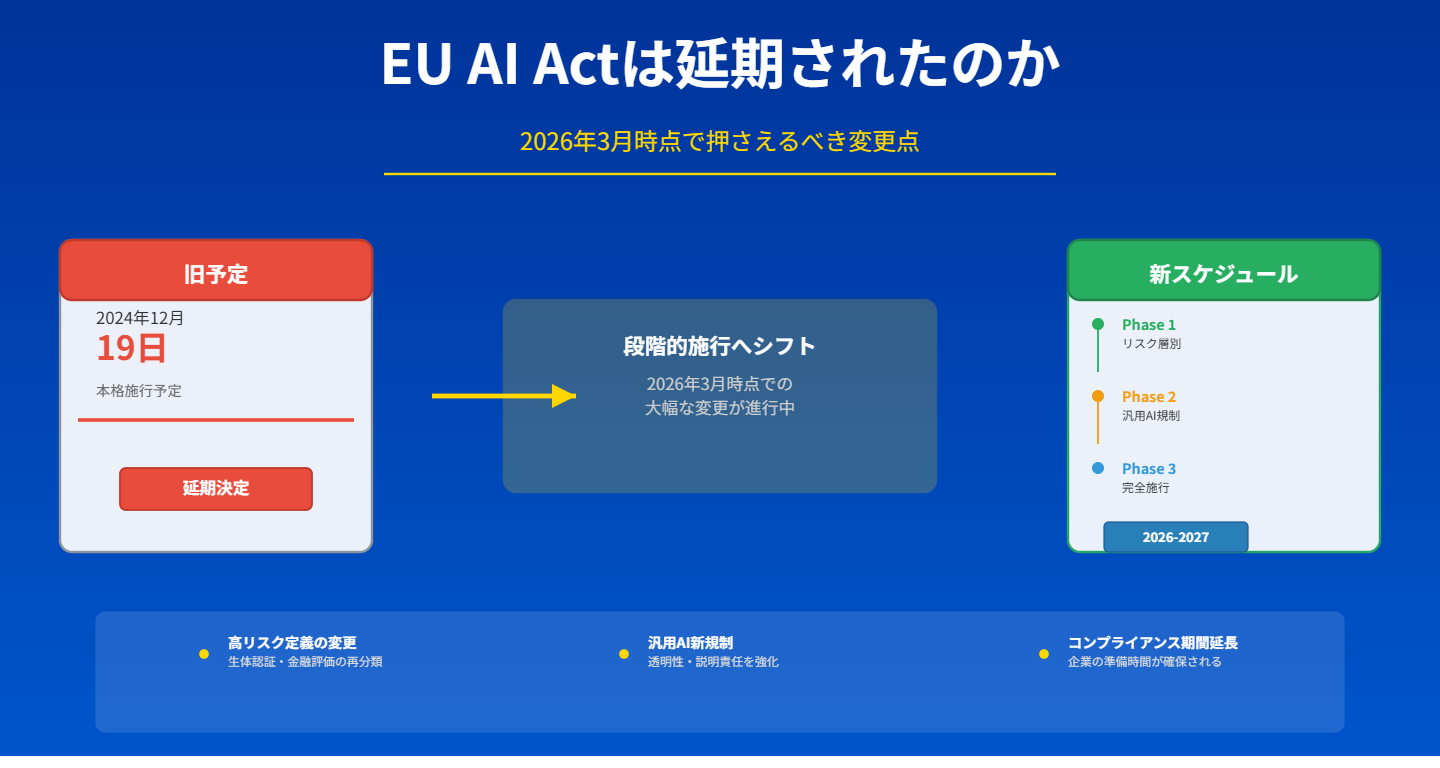

EU AI Actは延期されたのか 2026年3月時点で押さえるべき変更点

結論から言うと、EU AI Actが全面的に「もう延期で決まった」わけではありません。2026年4月3日時点では、欧州委員会が出した見直し案に対して、EU理事会と欧州議会がそろって延期方向の立場を示した段階です。最終的な法文はこれから両者の交渉で固まります。

ただし、流れはかなりはっきりしています。高リスクAIの主要ルールについては、もともとの2026年8月適用から後ろ倒しする案が、EU理事会と欧州議会の双方で支持されています。企業にとって重要なのは、「何がもう始まっていて、何がまだ確定していないか」を分けて見ることです。

- 要点だけ先に見ると、現時点でのポイントは3つです。

- 禁止AIとAIリテラシー義務は、すでに2025年2月2日から適用済みです。

- 高リスクAIの中核ルールは、延期案が強まっているものの、最終確定前です。

- 生成AIの透明性表示や高リスク分類に関わる準備は、先送り前提で止めるより、継続したほうが安全です。

ここがポイント: 「延期の方向」はかなり強い一方で、実務ではまだ“何もしなくていい”状態ではありません。すでに適用されている義務と、交渉中の義務を切り分ける必要があります。

まず結論 今の法的位置づけはどうなっているか

いま起きているのは、AI Actそのものの撤回ではなく、適用日程と一部運用の見直しです。

欧州委員会は2025年11月19日、いわゆる「Digital Omnibus」として、高リスクAIルールの適用時期を、必要な標準やガイダンスの整備状況と連動させる案を出しました。その後、EU理事会は2026年3月13日に交渉方針を採択し、欧州議会も2026年3月26日に独自の立場を採択しています。

この2つの機関が共通して示したのは、次の方向です。

- 単体の高リスクAIは、2027年12月2日への後ろ倒し

- 製品安全法制に組み込まれる高リスクAIは、2028年8月2日への後ろ倒し

- AI生成コンテンツの表示義務は、期限調整の対象になっている

- 非同意の性的ディープフェイクを生む「nudifier」系AIの禁止を強める流れがある

つまり、「AI Actが止まった」のではなく、高リスク分野の本格執行を、実務に合わせてずらす案が前に進んでいるというのが正確です。

何がすでに始まっているのか

ここを混同すると、実務判断を誤りやすくなります。AI Actは一括施行ではなく、段階的に適用されています。

2025年2月2日から適用済みのもの

欧州委員会のFAQによると、次の項目はすでに動いています。

- 禁止されるAI利用の一部

- AIの定義に関する基本規定

- AIリテラシー義務

このAIリテラシー義務が意味するのは、AIを提供・導入する組織が、現場の担当者に最低限の理解を持たせる責任を負うことです。法務部門だけ読んで終わりではなく、開発、運用、調達、現場利用まで巻き込む必要があります。

2025年8月2日から適用済みのもの

次に始まったのが、一般目的AIモデルに関する義務とガバナンス関連の規定です。

ここは大規模モデルの提供者に直結する領域ですが、利用企業にとっても無関係ではありません。なぜなら、どのモデルを使うか、どんな文書や説明を受け取れるか、契約上どこまで確認できるかに影響するからです。

現行法では2026年8月2日が大きな節目

欧州委員会の現行FAQでは、AI Actの大部分は2026年8月2日に適用される整理のままです。透明性義務の多くもこの日付が基準になっています。

このため、延期案が議論されていても、最終成立までは「8月を見ながら準備する」姿勢が現実的です。

今回の見直し案で何が変わりそうなのか

今回の焦点は、高リスクAIの適用日だけではありません。EUが「規制を緩める」のか、「実装可能な形に直す」のかも問われています。

欧州議会が2026年3月26日に示した立場

欧州議会は本会議で、見直し案に対する立場を賛成569、反対45、棄権23で採択しました。ここで重要なのは、延期を曖昧な条件付きにせず、固定日付で示したことです。

議会案の主な中身は次の通りです。

- Annex IIIに当たる単体の高リスクAIは2027年12月2日

- 安全・市場監視の分野別法制にかかるAIは2028年8月2日

- AI生成の音声、画像、動画、文章の出所表示は2026年11月2日まで猶予

- 非同意の性的画像を作る「nudifier」システムを禁止対象に追加

このうち最後の点は、単なる日程調整ではありません。生成AIが現実の被害と結びついたとき、EUがどこを優先して規制するのかを示しています。

EU理事会が2026年3月13日に示した立場

EU理事会も、欧州議会と近い方向を打ち出しました。

理事会案でも、単体の高リスクAIは2027年12月2日、製品組み込み型は2028年8月2日へ後ろ倒しする固定日付が示されています。加えて、各国のAI規制サンドボックス整備期限も2027年12月2日に後ろ倒しされました。

ここで見逃しにくいのは、理事会もまた、非同意の性的・親密画像や児童性的虐待素材を生むAIの禁止を入れていることです。議会と理事会の両方が同じ方向を向いているので、この論点は今後の交渉でも残る可能性が高いと見てよさそうです。

では、何がまだ確定していないのか

まだ確定していないのは、最終法文そのものです。

欧州議会の採択後は、理事会との交渉に入ります。したがって、2026年4月3日時点では次の理解が適切です。

- 延期の方向は強い

- 具体的な日付も議会と理事会でかなり近い

- それでも、最終成立前に「完全確定」とは言えない

このズレを無視して「8月対応は不要」と決め打ちすると、後で調整コストが跳ね返りやすいです。

なぜ延期が必要だと言われているのか

理由は比較的はっきりしています。高リスクAIを動かすための標準、ガイドライン、実務支援ツールが十分そろっていないからです。

欧州委員会の標準化ページでは、AI Actの高リスク義務に対応する欧州標準が、企業にとって法的確実性を与える役割を持つと説明されています。逆に言えば、標準が見えないままでは、企業は「何をどこまで整えれば適合と見なされるのか」を判断しにくい。

今回の延期論は、規制の理念を捨てる話というより、次の問題への対処です。

- 標準化作業が予定通り進いていない

- 各国当局の体制整備にも差がある

- 企業が技術文書や適合判断をそろえる基準が不足している

- そのまま2026年8月を迎えると、加盟国ごとの運用差が広がりかねない

EU側が繰り返し使う言葉は「法的確実性」と「比例的な実施」です。実務に落とせる形へ寄せたい、という意図が読み取りやすい場面です。

企業や現場は何を見ておくべきか

このニュースが重要なのは、AI法務チームだけの話ではないからです。採用、教育、金融、医療機器、重要インフラ、監視、本人確認のような領域でAIを使う組織ほど、影響が大きくなります。

いま止めずに進めたほうがいい準備

- 自社や導入済みAIが高リスク候補に当たるかの棚卸し

- ベンダーとの契約で、説明責任や文書提供の範囲を確認

- AI利用部門への教育と、社内ガイドラインの更新

- 透明性表示が必要になる生成AI利用の洗い出し

- ディープフェイクや性的画像生成に関する利用禁止ルールの明文化

特に人事、教育、与信、公共サービスに近い用途では、あとから「実は高リスクだった」と判明すると、運用設計を丸ごと見直すことになりがちです。延期論が出ている今こそ、分類と文書整理を進める価値があります。

逆に、早合点しやすいポイント

- 「延期案がある」ことと「延期が成立した」ことは別

- 全ての義務が先送りされるわけではない

- 生成AIの透明性やAIリテラシーは、準備を後ろに倒しにくい

- 禁止AIの領域は、むしろ強化の方向も見えている

ここを取り違えると、社内説明でも経営判断でもブレが出ます。

これからの注目点

次に見るべきなのは、理事会と欧州議会の交渉がどこまで早くまとまるかです。

とくに注目したいのは次の点です。

- 2026年8月2日を起点とする現行スケジュールが、どの時点で正式に書き換わるか

- 透明性義務、とくにAI生成コンテンツ表示の最終日程

- 「nudifier」禁止の定義がどこまで具体化されるか

- 高リスクAI向け標準やガイドラインが、いつ実務で使える形になるか

AI Actを巡る今の動きは、「EUのAI規制が後退した」というより、執行可能な形に組み替えながら、禁止領域ではむしろ線を太くしていると見るほうが実態に近いです。次の判断材料は、最終交渉の文言と、標準化の進み具合です。

参照リンク

- European Commission: Navigating the AI Act

- European Commission: Standardisation of the AI Act

- European Commission: Digital Omnibus on AI Regulation Proposal

- Council of the EU: Council agrees position to streamline rules on Artificial Intelligence

- European Parliament: Artificial Intelligence Act: delayed application, ban on nudifier apps